Вы всегда уверены в реальности своего собеседника, когда общаетесь в социальной сети? Можете ли быть убеждены в том, что ваш новый друг — настоящий человек? Нет, мы не ведем речь про людей-андроидов из произведений Айзека Азимова, и даже не говорим про призраков. Искусственный человек сегодня создается в один клик, но и жить он может только в виртуальном пространстве. Мы говорим про технологии нейросетей, которые могут генерировать фотографии людей, неотличимые от настоящих. Даже молодые пользователи сети не всегда замечают неладное, не говоря уже о детях и пенсионерах.

Да, симпатичный парень якобы из соседнего города, который зовет вашу подругу на безобидную встречу, может оказаться продуктом деятельности искусственного интеллекта. Как и улыбчивая девушка, на портрете которой вы даже разглядели естественные родинки и морщинки. Но как такое возможно? Сначала разберемся, какие технологии способны на подобного рода «подставу».

Откуда у фейка ноги растут

В 2014 году сотрудник Apple Ян Гудфеллоу представил идею генеративно-состязательных сетей (сокращенно GAN). Она представляет собой союз двух алгоритмов — генератора и дискриминатора, которые конкурируют друг с другом, что и позволяет назвать технологию «состязательной». Первая сеть генерирует изображения и пытается таким образом обмануть вторую, вторая же тщательно анализирует полученные данные. Чем успешнее первая сеть обманывает вторую, тем совершеннее становятся результаты GAN.

Чтобы вам было проще понять, как это работает, прибегнем к аналогии. Мошенник, который занимается созданием копий полотен великих художников, решает заключить союз с оценщиком. Он намерен через него продать влиятельным людям несколько фальшивых картин, которые были утеряны, а позже «нашлись». Оценщик подозрительно относится к партнеру, и понимает, что от него можно ожидать как оригинальную работу, так и подделку. Сначала он получает на оценку несколько работ якобы известного пейзажиста, но быстро находит подвох. Цвета не те, срок создания не сходится с известными ему датами, да и вообще техника не характерна для данного художника. Мошенник прикладывает усилия и постепенно учится обманывать зоркий глаз оценщика. Второй, в свою очередь, тоже повышает свои навыки, разоблачая все более ловкие приемы своего нечестного партнера. В итоге оценщик получает на свой стол мастерские подделки, которые легко принять за оригинал.

Ещё одно направление, в котором активно используются генеративно-состязательные сети — синтез изображения для видео-файлов. Более привычное уху российского пользователя название звучит как «дипфейк». Проще говоря, данная технология позволяет наложить лицо одного человека на видеоряд с другим, но так, чтобы «фейковое» лицо оборачивалось к нам под нужным углом, копировало мимику оригинала и так далее. Она широко применяется в кинематографе, рекламе и так далее. Увы, обратная сторона развития данной методики — простота создания поддельных видео с целью скомпрометировать и шантажировать кого-либо.

Две стороны одного прорыва

Получается, все эти нейросети — зло? Вовсе нет. Уже сейчас они крайне востребованы во многих областях, например игровой индустрии, рекламе и так далее. В прошлом году Сбер создал первую мультимодальную нейросеть ruDALL-E, которая генерирует картинки по описанию на русском языке. Можно попросить нарисовать «девушку с корзинкой в лесу», или же сгенерировать «заснеженные горы».

Но вот технология создания лиц несуществующих людей порой может обернуться проблемами для особо доверчивых граждан. Мошенники не хотят рисковать, воруя реальные фото из соцсетей — в наше время несложно найти оригиналы изображений. А сгенерированное фото уникально, к тому же непрофессионал почти не отличит работу нейросети от настоящего снимка.

С начала года, по информации пресс-службы ГУ МВД по региону, было зафиксировано 3598 фактов мошеннических действий с использованием информационных технологий. Годом ранее их за аналогичный период насчитывалось 3744, что на 3,9% больше, чем сейчас. К этой категории можно отнести мошеннические объявления в интернете от подставных лиц, фейковые сборы денег на якобы неотложные нужды, аферы на сайтах знакомств с просьбами «поддержать в трудной ситуации» и так далее.

Как считает доктор технических наук, профессор кафедры информационных систем и технологий НИУ ВШЭ в Нижнем Новгороде Андрей Савченко, нейросети все равно нельзя рассматривать однобоко.

Опасностей применения современных искусственных нейронных сетей достаточно много, впрочем, как и у любой развитой технологии. Создание поддельных видео, встраивание туда известных людей может быть использовано для их дискредитации. Технологии распознавания лиц могут применяться не только для поимки преступников, но и для вторжения в частную жизнь. При этом некоторые технологии уже сейчас превосходят ожидания и опасения фантастов прошлого.

Эксперимент с ожидаемым итогом

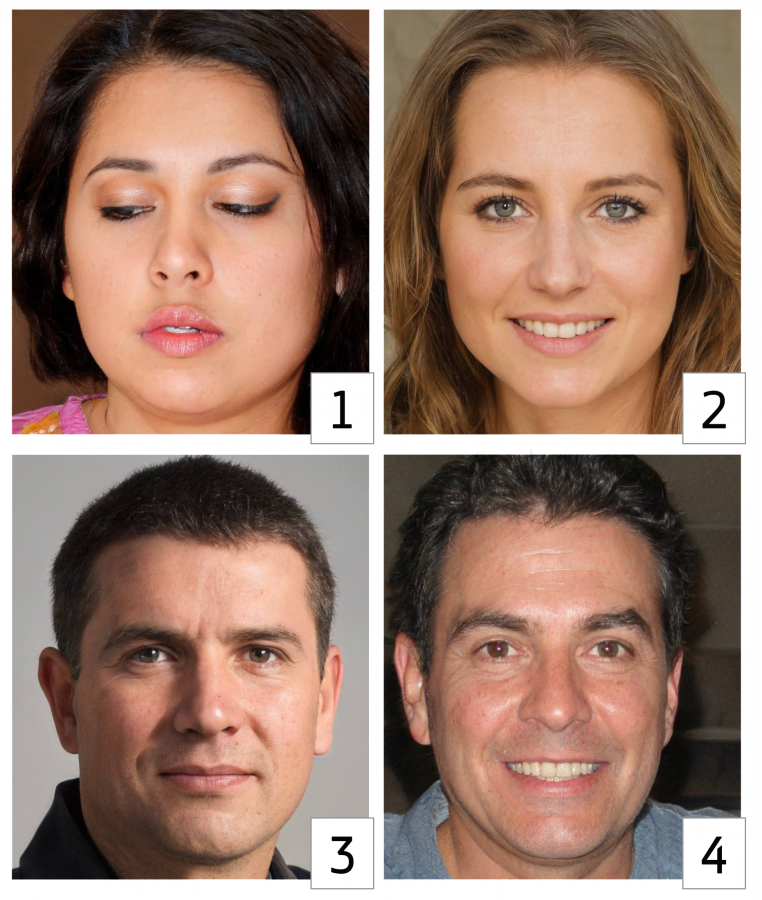

Одним из популярнейших сайтов для генерации поддельных портретов является , или «Этот человек не существует». Мы даже проверили, насколько легко с помощью таких картинок можно обмануть человека. Для этого наш журналист сгенерировала четыре портрета, при этом в подборку взяла как почти безупречную подделку, так и фото, на котором было легко найти изъяны в работе искусственного интеллекта. Затем она показала эти фото пятерым добровольцам, которые взялись отыскать там ненастоящих людей. Ни один из тех, кого мы привлекли к эксперименту, не смог понять, что поддельными являются все портреты. Однако мы попросили нижегородцев обосновать свое решение.

У второго и третьего — асимметрия в размере и расположении зрачков. И кожа у всех слишком гладкая и почти без пятен, что может говорить в пользу нейросети. Четвертый портрет точно настоящий, — рассказала Ксения.

Мужчина с короткой стрижкой ненастоящий — люди с асимметрией лица встречаются крайне редко. То же самое могу сказать о блондинке, ведь четко видно, что ее лицо склеено, — решил Дмитрий.

Некоторые испытуемые посчитали, что красные блики в глазах, словно от вспышки — это признак настоящего фото. Одна из девушек заметила странности на портрете брюнетки, например подозрительную форму губ. Отличительной особенностью итогов эксперимента стало то, что каждое фото рано или поздно подвергалось сомнению. Для одних мужчина на четвертом фото однозначно был фейком, другие сочли его вполне реальным. Одна из женщин и вовсе назвала мужчину на третьем фото «слишком хорошим» для живого человека. Выходит, что разоблачить работу нейросети все-таки можно? Да. Нужно уметь делать это, особенно с учётом того, что исходя из итогов нашего эксперимента, обмануть можно кого угодно.

Я обвиняю вас в нереальности

Как бы странно это ни звучало, но успех в определении подделки зависит не столько от умений и внимания конкретного человека, сколько от мастерства творения нейросети. Она может выдать откровенно подозрительное фото, так и почти шедеврального уровня фейк. Сейчас мы расскажем о признаках, которые помогут вам в этом нелегком деле, а для наглядности будем сопровождать каждый пример фото.

Посмотрите на эту женщину. Вполне симпатичная, не так ли? Но стоит только перевести взгляд левее, как сердце замирает в страхе. Что за монстр стоит рядом с нашей красоткой? Дело в том, что нейросети пытаются имитировать реальные снимки, на которых рядом с определенным человеком часто фотографируются другие люди. Вырезая портретное фото с групповых снимков, мы почти не можем избежать того, что на картинке остается чье-то плечо или даже часть щеки. Имитация этого явления — крайне слабое место в работе нейросетей на данный момент. Почти всегда при имитации части группового фото искусственный интеллект «уродует» потенциальных соседей фейкового человека, то пририсовывая им огромный рот, то награждая странной формой головы. Подобные находки на фото принято называть «артефактами».

С этим фото справиться чуть сложнее. Нейросеть решила изобразить женщину на однотонном фоне, допустив, правда, странный «косяк» в верхнем левом углу. Однако даже если мы посмотрим на лицо женщины, то найдем, за что зацепиться. Посмотрите на основание носа и вы увидите, что вместо плавного перехода света в тень граница там достаточно четкая. Кроме того, не совсем понятно, деталь чего именно мы видим чуть ниже лица женщины. Можно было бы посчитать это длинной серьгой, если бы на обращенном к нам ухе уже не находилась совершенно другая по форме.

Данный пример тоже не представляет сложности в вопросе нахождения артефактов. Фон в виде размытой зелени был бы идеальным решением, чтобы сделать фейк похожим на настоящий портрет, но в данном случае волосы девушки почему-то плавно перетекают в траву. Возможно, все дело в имитации повязки на голове, которая в данном случае сыграла как «разграничитель», обращая всё, что над ней, в растительность. Непонятно, куда делась вторая серьга, и что за продолговатый предмет уместился над левым плечом девушки.

Ну, а это разве тоже нейросеть? Тут и прицепиться-то не к чему! Примерно так вы можете подумать, глядя на данный снимок, и будете неправы. Это тоже продукт деятельности искусственного интеллекта, но даже здесь, несмотря на первоначальную «чистоту» картинки, есть артефакты. Помните, что нейросеть «спотыкается» в мелочах? И это именно такой случай, ведь нижний ряд зубов у мужчины на фото слился в один объект. Также можно распознать асимметрию в расположении ушей — одно значительноее ниже второго, но из-за того, что портрет сделан под небольшим углом, это замечаешь не сразу.

В данном случае смотреть нужно на фон. Если не обращать внимания, можно посчитать, что этот приятный мужчина просто сделал фото в отпуске, в каком-нибудь мексиканском или индийском городке, на фоне… чего именно? Если мы изучим все, что находится за его спиной, то поймем, что это просто комбинация из геометрических фигур, но наш мозг первоначально принимает это за городской пейзаж. Фон изображения — еще одно слабое место в работе нейросети.

Доктор технических наук Андрей Савченко считает, что в будущем даже продвинутые методы и эксперты будут неспособны отличить искусственно созданный портрет от настоящего.

Однако на данный момент алгоритмы создания реалистичных видео или фотографий групп людей в полный рост все еще достаточно далеки от совершенства, исследователям предстоит пройти еще достаточно большой путь, чтобы научиться создавать сложные сцены, а не только лица на размытом фоне, — говорит специалист.

Как мы писали ранее, нейросеть изобразила районы Нижнего Новгорода в виде юных девушек.